Comment les praticiens devraient-ils expliquer le fonctionnement des systèmes d'IA générative ?

•

•

4 minutes de lecture

Sujets

La transparence est une considération majeure dans la fiabilité de tout système d'IA. De plus en plus, elle devient également une exigence légale. Pourtant, il est notoirement difficile de comprendre et d'expliquer le fonctionnement des systèmes d'IA générative.

Les organisations à la pointe de l'adoption responsable de l'IA dépensent de plus en plus de ressources significatives sur la transparence de l'IA. JP Morgan a créé et doté un Centre d'Excellence en IA Explicable, qui informe ses efforts dans d'autres domaines, tels que l'équité, la responsabilité et la conformité. DARPA, l'agence de R&D du ministère de la Défense des États-Unis, a conduit des efforts importants pour faire avancer la transparence de l'IA dans des domaines comme la médecine et le transport.

Alors, qu'est-ce que la transparence de l'IA, et comment les organisations devraient-elles l'aborder pour les systèmes d'IA générative?

Qu'est-ce que la transparence?

Le Cadre de Gestion des Risques de l'IA du NIST décrit la transparence comme "une représentation des mécanismes sous-jacents au fonctionnement des systèmes d'IA." Alors, la question clé de la transparence de l'IA est : "Pourquoi le système d'IA a-t-il fourni un certain résultat?" Plus précisément, pourquoi la combinaison de modèles et de données a-t-elle fourni un certain résultat?

Il existe de nombreuses audiences potentielles pour la transparence de l'IA. Celles-ci incluent les développeurs du système d'IA, les organisations qui le déploient, les opérateurs humains, les vendeurs/acheteurs, les équipes de conformité, les régulateurs, les utilisateurs finaux concernés et le public. Chacune de ces audiences préfère généralement des communications à différents niveaux de détail.

Sous-jacente à ces explications se trouve quelque chose de plus technique – l'interprétabilité. Si la transparence est le "pourquoi", l'interprétabilité est le "comment."

Exemple de prêt bancaire

Prenons l'exemple d'une banque utilisant un système d'IA pour approuver ou refuser les demandes de prêt. Aux États-Unis, en refusant un prêt, une banque doit fournir au demandeur une explication du pourquoi la décision a été prise. Le but de cette explication est de démontrer que des informations précises ont été utilisées d'une manière qui est conforme aux processus décisionnels de la banque. Cela permet également au demandeur de corriger toute information incorrecte ou de contester la rigueur du processus.

Un demandeur de prêt préfère probablement des informations clairement communiquées, comme "Votre score de crédit était inférieur de 20 points au seuil d'approbation automatique et en outre, les actifs que vous avez fournis étaient insuffisants de 8 000 $ pour garantir le prêt directement."

Cependant, pour pouvoir fournir ce genre de déclaration claire, l'équipe des données et de l'IA de la banque doit comprendre comment les données d'entrée et les modèles constituant le système d'IA aboutissent à ces résultats (interprétabilité de l'IA). Cela nécessite, à son tour, une compréhension de la façon dont les modèles et les ensembles de données ont été développés et de quels types de gouvernance ils ont été soumis tout au long de leur cycle de vie.

Transparence pour l'IA générative

Étant donné que les systèmes d'IA générative reposent sur de vastes réseaux de neurones qui s'entraînent et traitent d'énormes quantités de données, leur fonctionnement est difficile à comprendre et à expliquer. Même les développeurs des systèmes d'IA générative les plus puissants rencontrent des difficultés à expliquer pourquoi leurs systèmes génèrent certaines sorties inexactes lorsqu'ils sont sollicités de certaines manières.

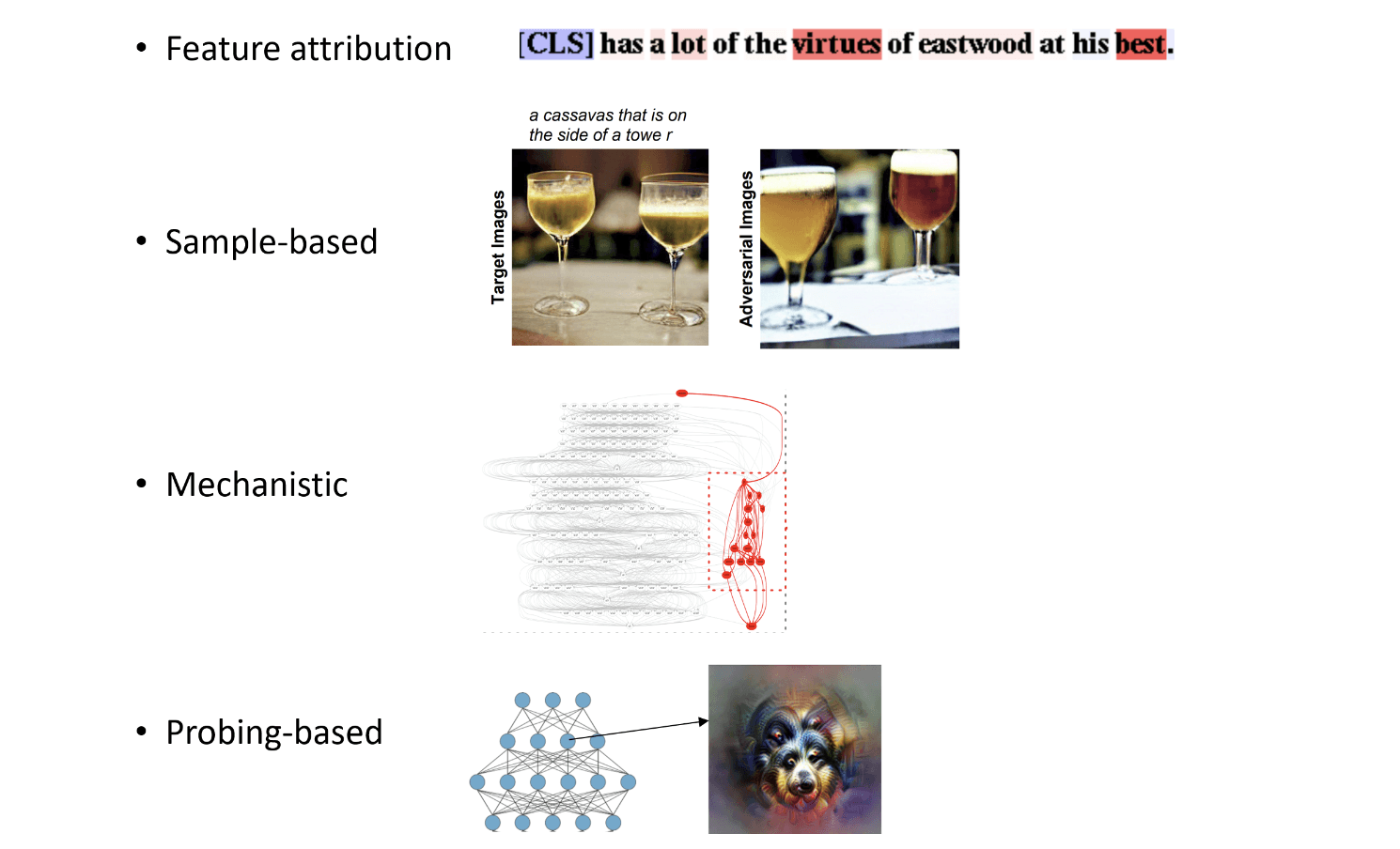

Les chercheurs ont adopté plusieurs approches différentes face à ce problème, et les universitaires ont étudié ces approches. Par exemple, Johannes Schneider de l'Université du Liechtenstein a développé une taxonomie des approches de recherche pour la transparence des systèmes d'IA générative.

Que signifie cela pour les praticiens?

Les dirigeants au sein des organisations comprennent le mieux leurs cas d'utilisation, la signification de leurs impacts et leurs exigences réglementaires. Ces considérations doivent informer les objectifs de leurs efforts de transparence de l'IA générative. Les normes seront élevées là où les enjeux sont importants – comme dans certains cas d'utilisation médicaux et financiers.

Collaborer entre les fonctions pour maintenir et développer une documentation de haute qualité tout au long du cycle de vie de chaque système d'IA est une condition préalable aux efforts de transparence de l'IA. Il est également important de créer la capacité de surveiller et d'adopter les méthodes de transparence de l'IA générative pertinentes aux cas d'utilisation communs de l'IA de l'organisation.

Enzai est là pour aider

La plateforme GRC d'IA d'Enzai peut aider votre entreprise à déployer l'IA conformément aux meilleures pratiques et aux réglementations, normes et cadres émergents, tels que le règlement AI de l'UE, le Colorado AI Act, le NIST AI RMF et ISO/IEC 42001. Pour en savoir plus, contactez-nous ici.

Donnez à votre organisation les moyens d'adopter, de gérer et de surveiller l'IA avec une confiance de niveau entreprise. Conçu pour les organisations réglementées opérant à grande échelle.