Les récentes actions et directives de la FTC ont des implications significatives pour les organisations

•

•

4 minutes de lecture

Sujets

La régulation américaine de l'IA est un patchwork. Pour commencer, les lois existantes à tous les niveaux s'appliquent aux systèmes d'IA. En ce qui concerne les règles générales pour l'IA, le cadre de gestion des risques de l'IA de NIST, faisant autorité, est volontaire, l'ordonnance exécutive sur l'IA de confiance de l'administration Biden et les orientations de l'OMB qui s'ensuivent s'appliquent uniquement au gouvernement fédéral, et le Colorado est actuellement le seul État à réglementer largement les systèmes d'IA. D'autres juridictions - comme la ville de New York et l'Illinois - ont réglementé des cas d'utilisation spécifiques de l'IA, comme le recrutement automatisé.

Actuellement, les orientations et actions de la Commission Fédérale du Commerce (“FTC”) des États-Unis offrent l'image la plus claire de la manière dont le gouvernement fédéral s'attend à ce que les entreprises déploient des systèmes d'IA. Les récentes orientations de la FTC ont tenté d'aborder les événements actuels avec rapidité. En février, la FTC a finalisé une règle interdisant l'utilisation de deepfakes d'IA pour usurper l'identité d'organisations ou d'agences gouvernementales. Le même mois, elle a averti les entreprises d'IA contre la modification furtive de leurs conditions de service avec effet rétroactif. Ces activités s'ajoutent à son examen des investissements et acquisitions par les grandes entreprises technologiques sous un angle antitrust. En mai, la présidente de la FTC, Lina Khan, a écrit un article d'opinion dans le New York Times, décrivant son approche proposée de la régulation de l'IA.

Pourquoi l'affaire Rite Aid de décembre était-elle si importante ?

En décembre 2023, la FTC a annoncé un règlement avec la chaîne de pharmacies Rite Aid. Rite Aid avait « utilisé la technologie de reconnaissance faciale dans des centaines de ses pharmacies de détail pour identifier les clients qu'elle avait auparavant jugés susceptibles de se livrer à du vol à l'étalage ou d'autres comportements criminels », selon une plainte de la FTC. Dans le règlement, Rite Aid a accepté de s'abstenir de déployer des systèmes de reconnaissance faciale pendant cinq ans dans ses magasins de détail ou en ligne et de supprimer les photos et vidéos des clients utilisées de manière inappropriée dans des systèmes de reconnaissance faciale, y compris les « données, modèles et algorithmes » dérivés de cette utilisation.

Quelles sont les implications pour les organisations utilisant l'IA ?

Le règlement de la FTC avec Rite Aid était notable pour deux raisons. Premièrement, il a démontré l'interprétation par la FTC de la discrimination par l'IA. Deuxièmement, il a marqué l'utilisation continue de la confiscation de modèles comme remède.

Discrimination par l'IA

Concernant la discrimination par l'IA, la FTC a noté que le déploiement par Rite Aid de systèmes de reconnaissance faciale ne tenait pas compte des taux élevés de faux positifs dans les différents groupes démographiques. Elle a également suggéré que le schéma des magasins choisis pour le déploiement de la reconnaissance faciale aurait un impact discriminatoire disproportionné sur les groupes minoritaires.

Confiscation de modèles

La FTC a également exigé la confiscation de modèles, un remède relativement nouveau qu'elle a inauguré en 2019, ce qui oblige une organisation à supprimer les données, modèles et algorithmes dérivés de l'utilisation inappropriée de systèmes d'IA. Depuis 2019, la FTC a précédemment exigé la confiscation de modèles dans de nombreux épisodes, y compris ceux liés à Cambridge Analytica, Everalbum, WW (anciennement Weight Watchers) et Ring. Il est probable que la FTC exigera la confiscation de modèles dans les futures actions d'application de l'IA.

Leçons

Certaines leçons que les organisations devraient tirer de l'épisode Rite Aid incluent:

· Réaliser des évaluations de risque de l'IA

· Mettre en place des programmes de formation complets pour les employés supervisant les systèmes d'IA à haut risque

· Considérer le contexte du déploiement de l'IA, y compris les impacts potentiellement discriminatoires

· Examiner les ensembles de données pour en vérifier l'exactitude, le biais et l'adéquation à l'objectif

· Être transparent avec les personnes sur l'utilisation qui sera faite de leurs données

· Être réfléchi quant à la façon, et dans quelle mesure, de décrire les systèmes d'IA au public et aux régulateurs

· Évaluer les pratiques de confidentialité et d'IA responsable des fournisseurs

Enzai est là pour vous aider

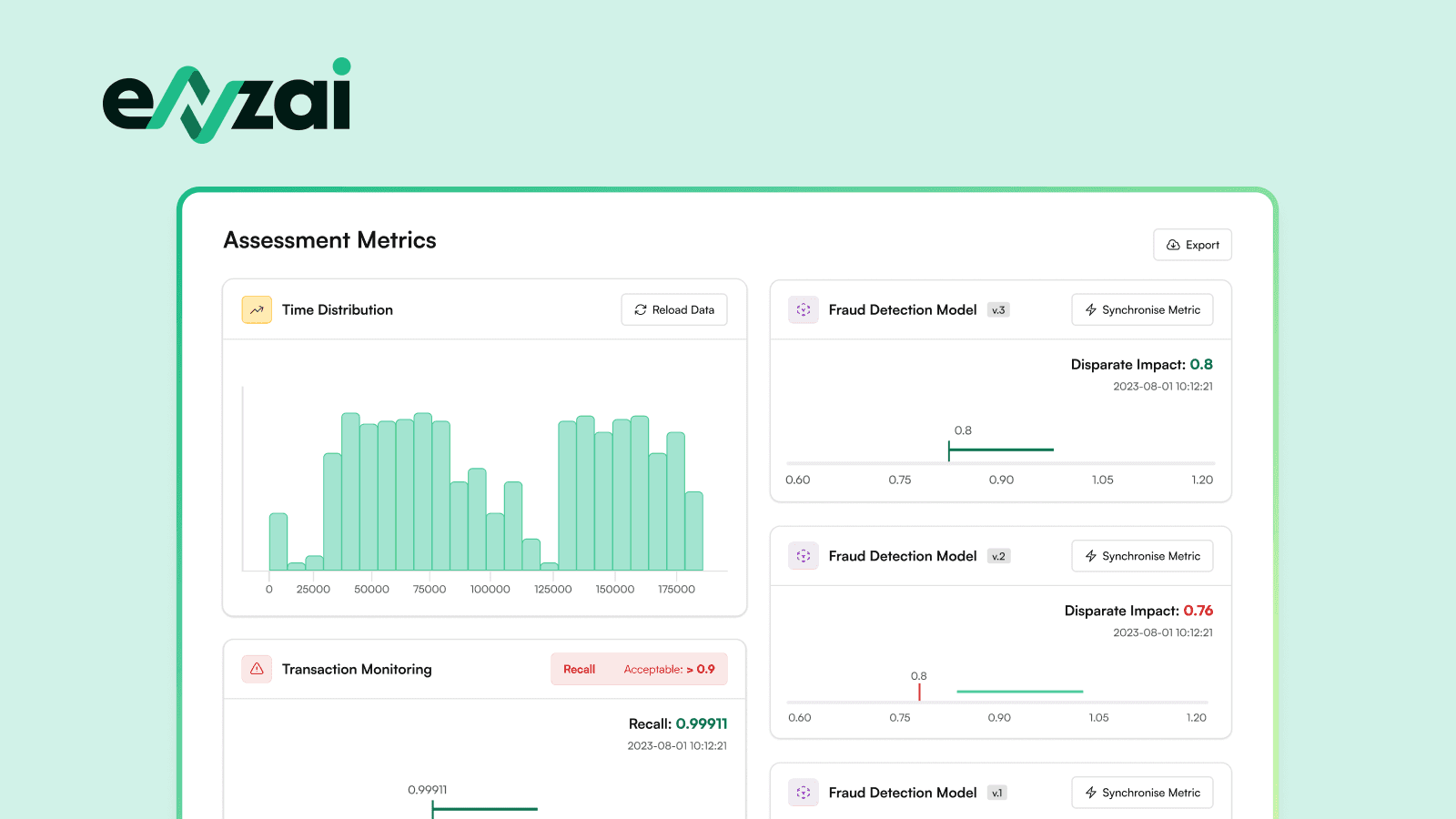

Le produit Enzai peut aider votre entreprise à déployer l'IA conformément aux meilleures pratiques et aux réglementations, normes et cadres émergents, tels que la loi européenne sur l'IA, la loi du Colorado sur l'IA, le cadre de gestion des risques de l'IA du NIST et l'ISO/IEC 42001. Pour en savoir plus, contactez-nous ici.

Donnez à votre organisation les moyens d'adopter, de gérer et de surveiller l'IA avec une confiance de niveau entreprise. Conçu pour les organisations réglementées opérant à grande échelle.