Ein Überblick über die Bedeutung und Bestandteile des Colorado AI Act

•

•

4 Minuten Lesezeit

Themen

Am 17. Mai 2024 unterzeichnete Colorados Gouverneur Jared Polis das Colorado Artificial Intelligence Act („CAIA“). Das CAIA stellt einen bedeutenden Meilenstein für die US-AI-Regulierung dar, da es das erste Staatsgesetz ist, das ein breites Spektrum von AI-Systemen abdeckt. Obwohl ein ähnliches Gesetz in Connecticut nicht verabschiedet wurde, ist es wahrscheinlich, dass andere Staaten dem Beispiel von Colorado folgen werden und AI-Nutzung umfassend regulieren.

Wie vergleicht sich das CAIA mit dem EU-AI-Gesetz?

Das CAIA ist dem EU-AI-Gesetz in drei Punkten ähnlich.

Erstens betreffen die meisten Anforderungen in beiden Gesetzen Hochrisiko-AI-Systeme. Zweitens kann die Übereinstimmung mit beiden Gesetzen wesentlich durch die Konformität mit Standards wie ISO/IEC 42001 - AI Management Systems gezeigt werden. Drittens fordern beide Gesetze Impact Assessments für Hochrisiko-Systeme.

Es gibt auch mindestens zwei wesentliche Unterschiede zwischen dem CAIA und dem EU-AI-Gesetz.

Erstens sind die Anforderungen des EU-AI-Gesetzes tiefergehend als die des CAIA. Das CAIA, das sich primär mit algorithmischer Diskriminierung beschäftigt, schließt mehrere gängige Arten von AI-Systemen aus seiner Definition von Hochrisiko-AI-Systemen aus. Es befreit auch Betreiber mit weniger als 50 Mitarbeitern von vielen seiner Anforderungen, wenn sie bestimmte Kriterien erfüllen.

Zweitens treten die meisten Bestimmungen des CAIA viel früher in Kraft als die des EU-AI-Gesetzes. Unternehmen haben knapp 20 Monate Zeit, um das CAIA zu erfüllen, da es am 1. Februar 2026 in Kraft tritt. Im Vergleich dazu werden die Anforderungen des EU-AI-Gesetzes für Hochrisiko-Systeme erst Mitte 2026, 24 Monate nach seiner Veröffentlichung im EU-Amtsblatt, wirksam.

Welche AI-Systeme sind durch das CAIA abgedeckt?

Das CAIA gilt für Entwickler oder Betreiber von AI-Systemen, die in Colorado geschäftlich tätig sind. Ein Entwickler ist jemand, der ein AI-System entwickelt oder absichtlich und substanziell verändert, während ein Betreiber jemand ist, der ein Hochrisiko-AI-System einsetzt.

Laut CAIA ist ein AI-System hochriskant, wenn es bei der Implementierung „eine wesentliche Rolle bei der Entscheidungsfindung“ spielt oder ein solcher Faktor ist. Eine entscheidende Entscheidung ist eine, die „eine wesentliche rechtliche oder ähnlich bedeutende Wirkung auf die Bereitstellung oder Verweigerung gegenüber einem Verbraucher hat oder auf die Kosten oder Bedingungen von“ Zugang zu Bildung, Arbeitsmöglichkeiten, Finanz- oder Kreditdienstleistungen, wesentliche Regierungsdienstleistungen, Gesundheitsvorsorge, Wohnen, Versicherung oder juristische Dienstleistungen. Zudem fallen einige Arten von AI-Systemen nicht in die Hochrisikokategorie.

Wie wird das CAIA durchgesetzt?

Der Generalstaatsanwalt von Colorado wird die ausschließliche Befugnis haben, es durchzusetzen und Regeln sowie Richtlinien dazu zu erlassen. Das CAIA gewährt kein privates Klagerecht. Wenn der Generalstaatsanwalt von Colorado eine Vollzugsmaßnahme einleitet, hat ein Betreiber die „widerlegbare Vermutung“, dass er angemessen gehandelt hat, um Verbraucher vor algorithmischer Diskriminierung zu schützen, wenn er eine Risikomanagementrichtlinie und -programm hat, die mit dem NIST AI-Risikomanagement-Framework („AI RMF“) oder der ISO/IEC 42001 übereinstimmen. Zusätzlich hat ein Unternehmen in einem Vollzugsverfahren eine „schlüssige Verteidigung“, wenn es eine CAIA-Verletzung aufgrund von Feedback, adversarial Testing oder Red Teaming (wie diese Begriffe vom NIST definiert sind) oder eines internen Überprüfungsverfahrens entdeckt und behebt sowie „sonst in Übereinstimmung mit“ dem NIST AI RMF und ISO/IEC 42001 steht.

Für weitere Informationen zur Entwicklung einer Risikomanagementrichtlinie und -programm fordern Sie unseren kostenlosen und umfassenden Leitfaden zur Erstellung einer AI-Richtlinie hier an.

Was verlangt das CAIA von Entwicklern und Betreibern von Hochrisiko-AI-Systemen?

Das CAIA verlangt von Entwicklern und Betreibern, „angemessene Sorgfalt“ walten zu lassen, um Einzelpersonen vor bekannten oder vorhersehbaren Risiken der algorithmischen Diskriminierung zu schützen und die Anwendungen ihrer Hochrisiko-AI-Systeme auf ihren Websites zu beschreiben.

Entwickler sind verpflichtet, den Generalstaatsanwalt von Colorado und bekannte Betreiber unverzüglich und innerhalb von 90 Tagen über bekannte oder vorhersehbare Risiken der algorithmischen Diskriminierung zu informieren. Betreiber sind verpflichtet, den Generalstaatsanwalt von Colorado zu benachrichtigen, sobald sie erfahren, dass ein System algorithmische Diskriminierung verursacht hat, unverzüglich und innerhalb von 90 Tagen.

Entwickler sind verpflichtet, „eine allgemeine Erklärung abzugeben, die vernünftigerweise vorhersehbare Verwendungen und bekannte schädliche oder unangemessene Verwendungen des Systems beschreibt“ sowie die zugehörige Dokumentation zu liefern.

Betreiber sind verpflichtet, jährlich und innerhalb von 90 Tagen nach jeder „absichtlichen und substanziellen Änderung“ des AI-Systems Bewertungen der Auswirkungen durchzuführen.

Betreiber sind verpflichtet, eine Risikomanagementrichtlinie und -programm zu haben, Einzelpersonen zu informieren, bevor ein AI-System eine wesentliche Entscheidung trifft, den Einzelpersonen zu erklären, wie nachteilige wesentliche Entscheidungen getroffen wurden, die Möglichkeit zur Korrektur falscher personenbezogener Daten im Zusammenhang mit solchen Entscheidungen zu bieten und Möglichkeiten zur Anfechtung solcher Entscheidungen zu schaffen.

Alle AI-Systeme müssen „gekennzeichnet“ werden

Während sich die meisten Anforderungen des CAIA auf Hochrisiko-AI-Systeme beziehen, gilt die Kennzeichnungspflicht für alle AI-Systeme, die dazu bestimmt sind, mit Einzelpersonen zu interagieren. Für solche Systeme muss ein Entwickler oder Betreiber einem Individuum offenlegen, dass es mit einem AI-System interagiert, es sei denn, dies wäre „offensichtlich für eine vernünftige Person“.

Enzai ist hier, um zu helfen

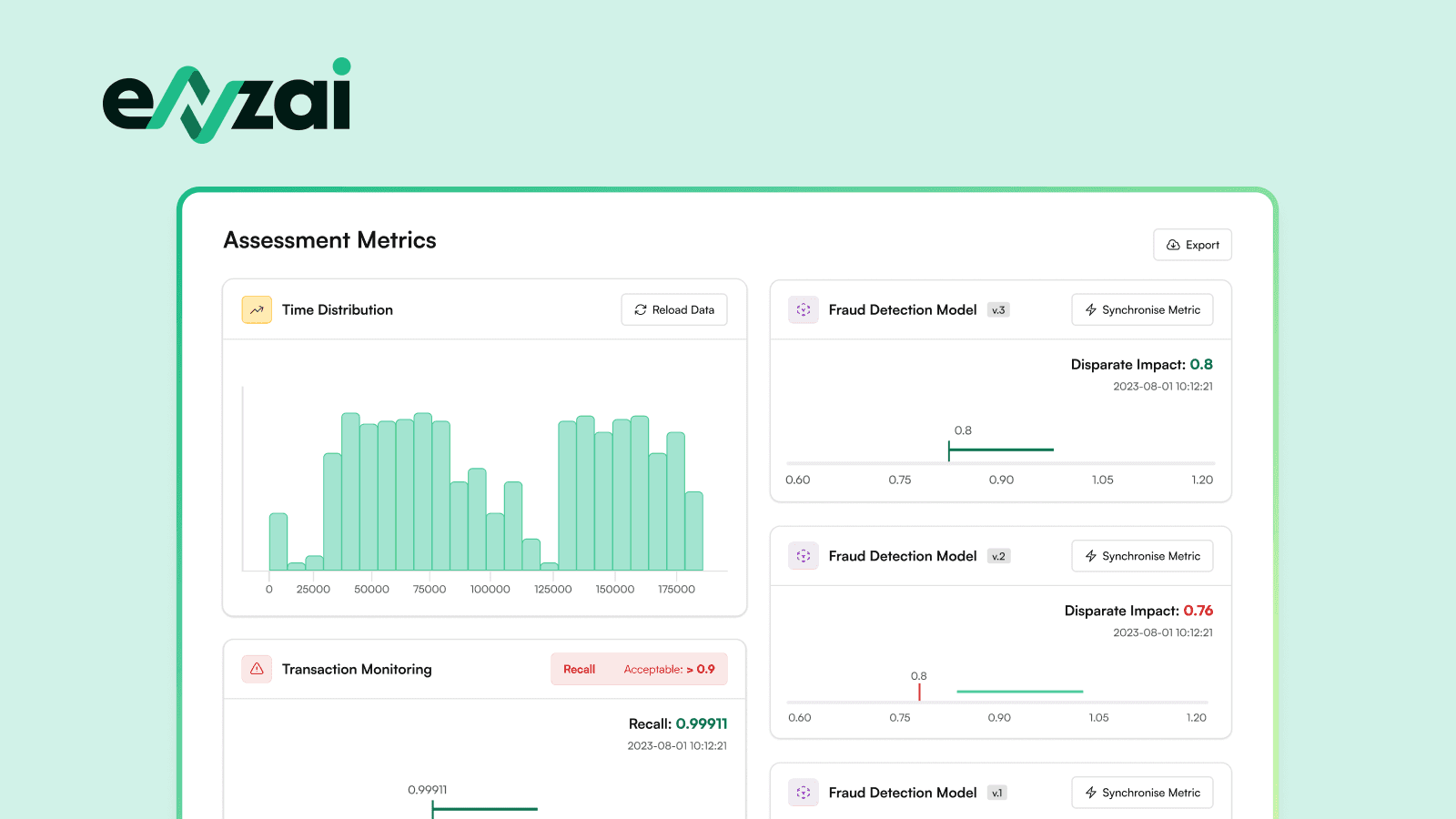

Das Produkt von Enzai kann Ihrem Unternehmen helfen, die Anforderungen von Colorado, das NIST AI RMF, ISO/IEC 42001, das EU-AI-Gesetz und andere globale Regulierungs- und Sicherheitsregime zu erfüllen. Um mehr zu erfahren, kontaktieren Sie uns hier.

Ermöglichen Sie Ihrer Organisation die Einführung, Steuerung und Überwachung von KI mit unternehmensgerechtem Vertrauen. Entwickelt für regulierte Organisationen, die im großen Maßstab operieren.