実務家は、生成型AIシステムの動作をどのように説明すべきでしょうか?

•

•

8 最小読了時間

トピック

説明可能性は、あらゆる AI システムの信頼性における重要な要素です。さらに、これは法的要件でもあります。しかし、生成 AI システムの仕組みを理解し、説明することは極めて困難です。

責任ある AI 導入の最前線にある組織では、AI の説明可能性に多大なリソースを投入する傾向が強まっています。JP Morgan は Explainable AI Center of Excellence を設立し、十分な体制を整備しており、その知見は、公平性、説明責任、コンプライアンスといった他分野への取り組みにも活かされています。米国国防総省の研究開発機関である DARPA は、医療や交通などの分野において AI の説明可能性を前進させるための大規模な取り組みを主導してきました。

では、AI の説明可能性とは何でしょうか。また、組織は生成 AI システムに対してどのように取り組むべきでしょうか。

説明可能性とは何か

NIST AI Risk Management Framework では、説明可能性を「AI システムの動作を支えるメカニズムを表現したもの」と説明しています。したがって、AI の説明可能性における重要な問いは、「なぜ AI システムは特定の出力を提示したのか」という点です。より具体的には、モデルとデータの組み合わせがなぜ特定の出力を生んだのか、ということです。

AI の説明可能性には、開発者、導入組織、人間のオペレーター、販売者/購入者、コンプライアンス チーム、規制当局、影響を受けるエンドユーザー、そして一般の人々など、多様な対象者が存在します。これらの対象者はそれぞれ、通常、異なる詳細度の説明を求めます。

こうした説明の根底にある、より技術的な概念が解釈可能性です。説明可能性が「なぜ」であるなら、解釈可能性は「どのように」です。

銀行融資の例

AI システムを用いて融資申請を承認または否認する銀行の例を考えてみましょう。米国では、融資を否認する際、銀行は申請者に対して、その判断が下された理由を説明しなければなりません。この説明の目的は、正確な情報が銀行の意思決定プロセスに沿った形で使用されたことを示すことにあります。また、申請者に対して、不正確な情報を修正する機会や、手続きの厳格性に異議を申し立てる機会も提供します。

融資申請者は、おそらく「お客様の信用スコアは自動承認基準を 20 ポイント下回っており、さらに、ご提示いただいた資産額は、融資の確定に必要な金額を 8,000 ドル下回っていました」といった、明確に伝えられた情報を望むでしょう。

しかし、このような明確な説明を行うには、銀行のデータ チームと AI チームが、データ入力と AI システムを構成するモデルがどのようにして出力を生み出すのかを理解している必要があります(AI の解釈可能性)。そのためには、モデルやデータセットがどのように開発され、ライフサイクル全体を通じてどのようなガバナンス下に置かれていたのかを理解することも求められます。

生成 AI の説明可能性

生成 AI システムは、大規模なニューラルネットワークを基盤とし、膨大な量のデータを学習・処理するため、その仕組みを理解し、説明することは困難です。最も高性能な生成 AI システムであっても、開発者は、特定の指示に対してなぜ自社のシステムが特定の不正確な出力を生成するのかを説明することに苦慮しています。

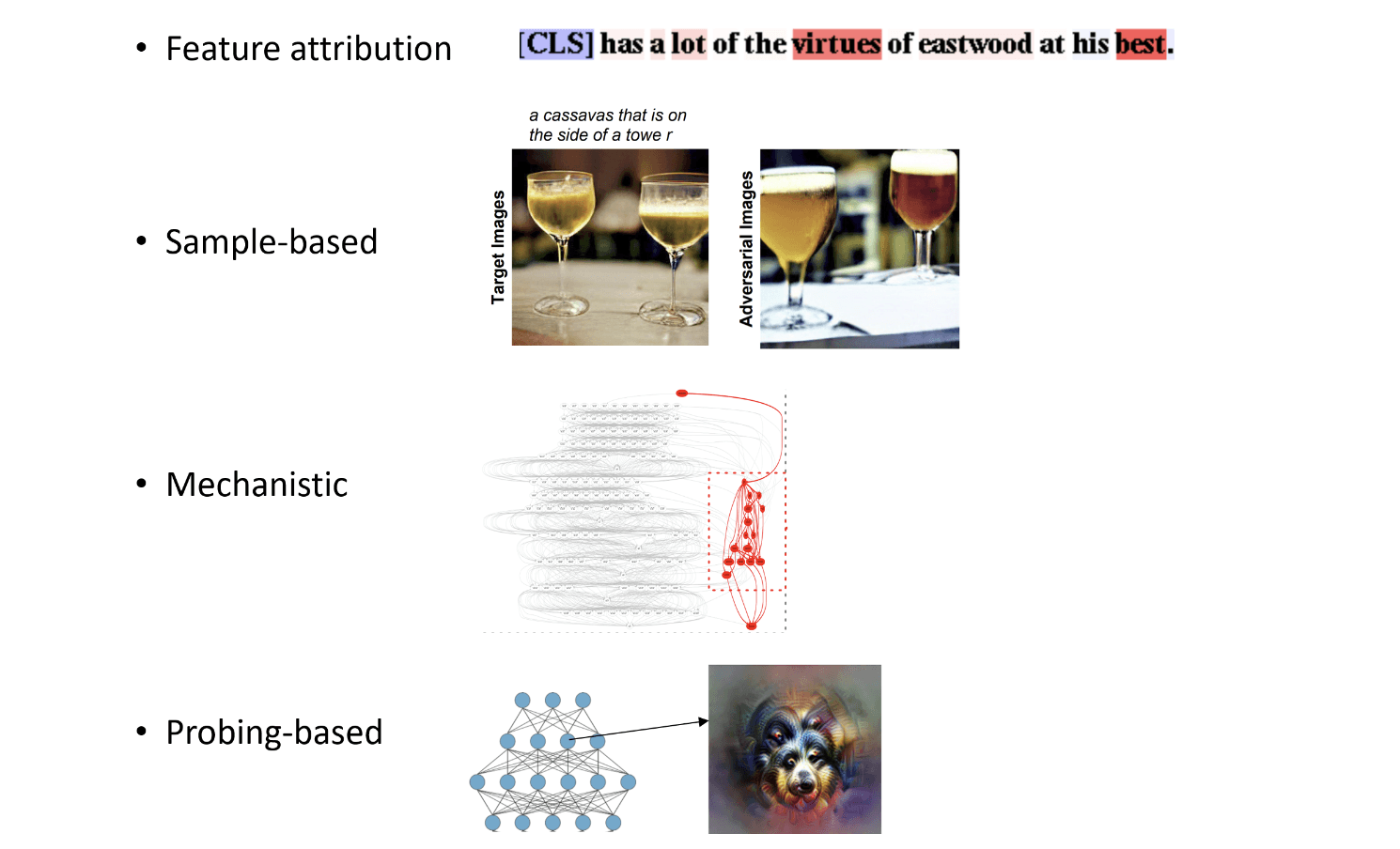

研究者はこの課題に対して複数の異なるアプローチを採用しており、学術研究者たちもそれらを整理・調査しています。たとえば、リヒテンシュタイン大学の Johannes Schneider は、生成 AI システムにおける説明可能性に関する研究アプローチの分類体系を開発しました。

これは実務担当者にとって何を意味するのでしょうか。

組織内のリーダーは、自社のユースケース、その影響の重大性、および規制要件を最もよく理解しています。これらの考慮事項は、生成 AI の説明可能性に関する取り組みの目的に反映されるべきです。特に医療や金融など、重大性の高いユースケースでは、求められる基準もより高くなります。

AI システムのライフサイクル全体を通じて、高品質な文書を維持・整備するために部門横断で連携することは、AI の説明可能性に向けた取り組みの前提条件です。さらに、組織に共通する AI ユースケースに関連する生成 AI の説明可能性手法を監視し、導入していく能力を構築することも重要です。

Enzai が支援します

Enzai の AI GRC プラットフォームは、EU AI Act、Colorado AI Act、NIST AI RMF、ISO/IEC 42001 などの最新の規制、標準、フレームワークおよびベストプラクティスに準拠した AI 導入を支援します。詳細については、こちらからお問い合わせください。

Enzai は、抽象的な方針から運用レベルの監督へと組織が移行することを支援するために特化して設計された、業界をリードするエンタープライズ AI ガバナンス プラットフォームです。当社の AI リスク管理プラットフォーム は、エージェント型 AI ガバナンス の管理、包括的な AI インベントリ の維持、EU AI Act への準拠 を実現するために必要な専門的インフラを提供します。複雑なワークフローを自動化することで、Enzai は、企業が確信を持って AI 導入を拡大できるよう支援しながら、ISO 42001 や NIST などのグローバル標準との整合性を維持します。

組織がAIを採用し、管理し、監視する能力を、企業レベルの信頼性で強化します。規模で運営する規制対象の組織向けに構築されています。