Wie sollten Fachleute die Funktionsweise von generativen KI-Systemen erklären?

•

•

4 Minuten Lesezeit

Themen

Erklärbarkeit ist ein wesentlicher Aspekt der Vertrauenswürdigkeit jedes KI-Systems. Zunehmend ist sie auch eine rechtliche Anforderung. Dennoch ist es bekanntermaßen schwierig, die Funktionsweise generativer KI-Systeme zu verstehen und zu erklären.

Unternehmen, die bei der verantwortungsvollen Einführung von KI an der Spitze stehen, investieren zunehmend erhebliche Ressourcen in die Erklärbarkeit von KI. JP Morgan hat ein Explainable AI Center of Excellence eingerichtet und mit Ressourcen ausgestattet, das seine Aktivitäten in anderen Bereichen wie Fairness, Rechenschaftspflicht und Compliance unterstützt. DARPA, die Forschungs- und Entwicklungsagentur des US-Verteidigungsministeriums, hat bedeutende Initiativen vorangetrieben, um die Erklärbarkeit von KI voranzubringen in Bereichen wie Medizin und Transportwesen.

Was ist also KI-Erklärbarkeit, und wie sollten Unternehmen bei generativen KI-Systemen vorgehen?

Was ist Erklärbarkeit?

Das NIST AI Risk Management Framework beschreibt Erklärbarkeit als „eine Darstellung der Mechanismen, die dem Betrieb von KI-Systemen zugrunde liegen.“ Die zentrale Frage der KI-Erklärbarkeit lautet daher: „Warum hat das KI-System eine bestimmte Ausgabe geliefert?“ Genauer gesagt: Warum hat die Kombination aus Modellen und Daten eine bestimmte Ausgabe erzeugt?

Es gibt viele potenzielle Zielgruppen für KI-Erklärbarkeit. Dazu zählen die Entwickler des KI-Systems, einsetzende Unternehmen, menschliche Bediener, Anbieter/Käufer, Compliance-Teams, Aufsichtsbehörden, betroffene Endnutzer und die Öffentlichkeit. Jede dieser Zielgruppen bevorzugt in der Regel Informationen mit unterschiedlichem Detaillierungsgrad.

Den Erklärungen liegt etwas Technischeres zugrunde – die Interpretierbarkeit. Wenn Erklärbarkeit das „Warum“ ist, dann ist Interpretierbarkeit das „Wie“.

Beispiel für einen Bankkredit

Nehmen wir das Beispiel einer Bank, die ein KI-System einsetzt, um Kreditanträge zu genehmigen oder abzulehnen. In den USA muss eine Bank bei einer Kreditablehnung dem Antragsteller eine Erklärung dafür liefern, warum die Entscheidung getroffen wurde. Der Zweck dieser Erklärung besteht darin, nachzuweisen, dass korrekte Informationen in einer Weise verwendet wurden, die mit den Entscheidungsprozessen der Bank übereinstimmt. Außerdem erhält der Antragsteller die Möglichkeit, unzutreffende Informationen zu korrigieren oder die Nachvollziehbarkeit des Verfahrens anzufechten.

Ein Kreditantragsteller bevorzugt wahrscheinlich klar kommunizierte Informationen, etwa: „Ihre Bonitätsbewertung lag 20 Punkte unter der Schwelle für die automatische Genehmigung, und zudem lagen die von Ihnen angegebenen Vermögenswerte 8.000 US-Dollar unter dem Betrag, der für die direkte Kreditvergabe erforderlich war.“

Um eine derart klare Aussage treffen zu können, muss das Daten- und KI-Team der Bank verstehen, wie die Dateneingaben und die das KI-System bildenden Modelle zu den Ausgaben führen (KI-Interpretierbarkeit). Dies wiederum erfordert ein Verständnis dafür, wie die Modelle und Datensätze entwickelt wurden und welchen Governance-Prozessen sie über ihren gesamten Lebenszyklus hinweg unterlagen.

Erklärbarkeit für generative KI

Da generative KI-Systeme auf massiven neuronalen Netzen basieren, die enorme Datenmengen trainieren und verarbeiten, ist ihre Funktionsweise schwer zu verstehen und zu erklären. Selbst die Entwickler der leistungsfähigsten generativen KI-Systeme haben Schwierigkeiten zu erklären, warum ihre Systeme auf bestimmte Eingaben hin konkrete, fehlerhafte Ausgaben erzeugen.

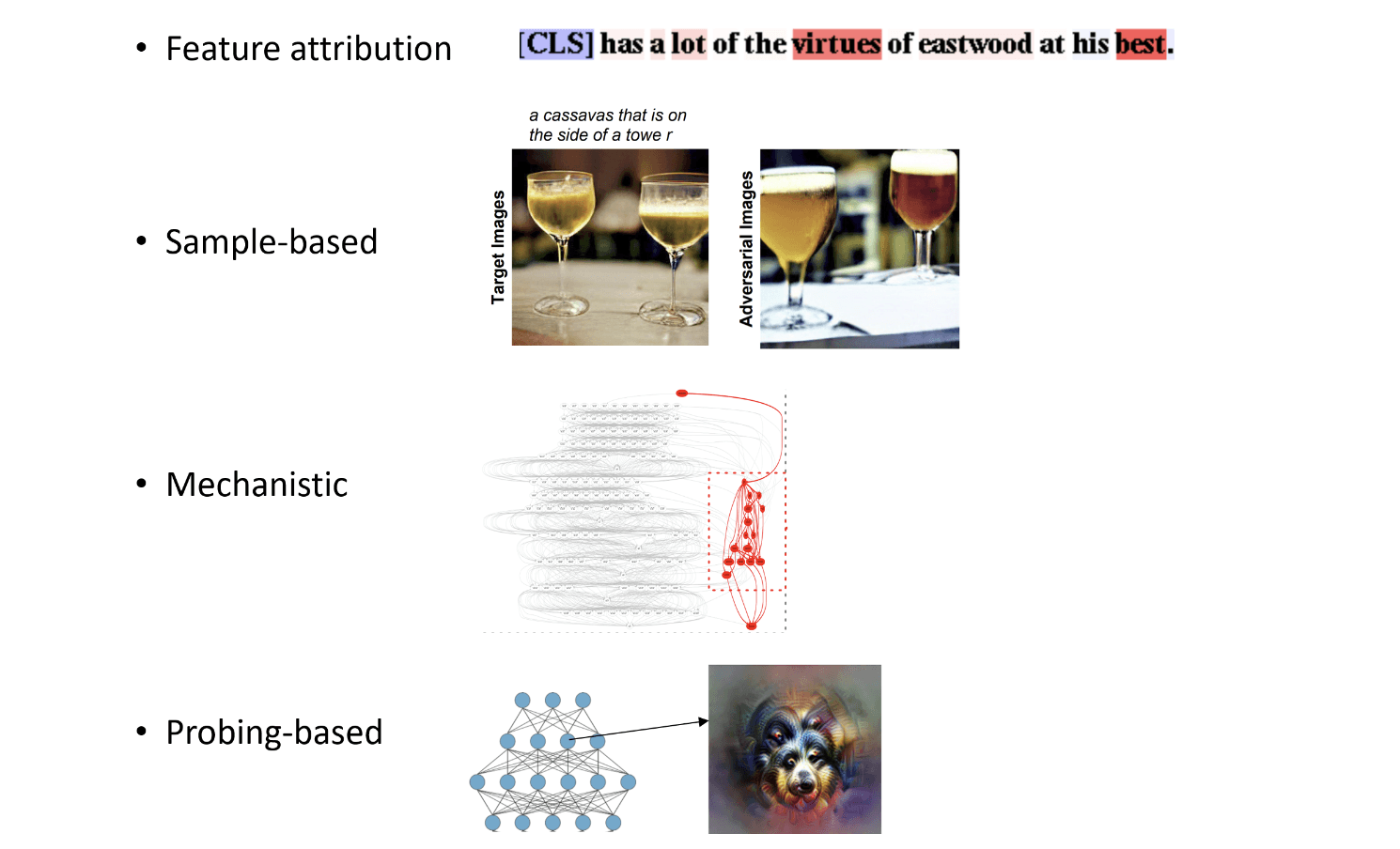

Forscher haben mehrere unterschiedliche Ansätze für dieses Problem entwickelt, und Wissenschaftler haben diese Ansätze untersucht. So hat beispielsweise Johannes Schneider von der Universität Liechtenstein eine Taxonomie entwickelt für Forschungsansätze zur Erklärbarkeit generativer KI-Systeme.

Was bedeutet das für Praktiker?

Führungskräfte in Unternehmen verstehen ihre Anwendungsfälle, die Bedeutung ihrer Auswirkungen und ihre regulatorischen Anforderungen am besten. Diese Überlegungen sollten die Ziele ihrer Bemühungen zur Erklärbarkeit generativer KI prägen. Die Standards werden höher sein, wenn die Risiken größer sind – etwa in bestimmten medizinischen und finanziellen Anwendungsfällen.

Die funktionsübergreifende Zusammenarbeit zur Aufrechterhaltung und Entwicklung hochwertiger Dokumentation während des gesamten Lebenszyklus jedes KI-Systems ist eine Grundvoraussetzung für Bemühungen zur KI-Erklärbarkeit. Darüber hinaus ist es wichtig, die Fähigkeit zu schaffen, die für die typischen KI-Anwendungsfälle des Unternehmens relevanten Methoden zur Erklärbarkeit generativer KI zu überwachen und einzuführen.

Enzai unterstützt Sie dabei

Die AI-GRC-Plattform von Enzai kann Ihrem Unternehmen helfen, KI im Einklang mit Best Practices und neuen Vorschriften, Standards und Rahmenwerken wie dem EU AI Act, dem Colorado AI Act, dem NIST AI RMF und ISO/IEC 42001 einzusetzen. Um mehr zu erfahren, Nehmen Sie hier Kontakt auf.

Enzai ist die führende Enterprise-KI-Governance-Plattform, speziell entwickelt, um Unternehmen den Übergang von abstrakter Richtlinie zu operativer Aufsicht zu ermöglichen. Unsere Plattform für KI-Risikomanagement bietet die spezialisierte Infrastruktur, die erforderlich ist, um eine agentische KI-Governance zu steuern, ein umfassendes KI-Inventar zu pflegen und die Einhaltung des EU AI Act sicherzustellen. Durch die Automatisierung komplexer Workflows versetzt Enzai Unternehmen in die Lage, die Einführung von KI mit Vertrauen zu skalieren und gleichzeitig die Ausrichtung an globalen Standards wie ISO 42001 und NIST zu wahren.

Ermöglichen Sie Ihrer Organisation die Einführung, Steuerung und Überwachung von KI mit unternehmensgerechtem Vertrauen. Entwickelt für regulierte Organisationen, die im großen Maßstab operieren.