EU AI法の主要要件の概要と、コンプライアンスを確保するために必要な手続きをご紹介します。

•

•

13 最小読了時間

トピック

2024年1月22日、欧州連合AI法(「AIA」)の最終テキストが公開されました。この法律は、AIエコシステム全体に多くの新しい義務を課し、不遵守には大きな罰則が伴うため、組織はすぐに行動を開始する必要があります。

このブログでは、組織が遵守を確保するために考慮すべき重要な事項をいくつかご紹介します。

義務事項

第16条は、高リスクAIシステムの提供者に対する主要な義務を定めています。これらの遵守義務の核心は、品質管理システム、リスク管理システムの確立、詳細な技術文書の準備と維持、適合性評価の実施にあります。これらの要件を個別に分解し、組織が行うべき具体的なアドバイスを提供します。

このブログで述べられている義務を遵守する法的要件は、主にEUの定義する高リスクのAIシステムに適用されますが、これに該当しないAIシステムでも企業に重大なリスクを与える可能性があり、進化に伴って定義に該当することもあります。AIAは、組織が自主的にこの法的枠組みの特定の要件を採用することを推奨しています。我々の観点からは、リスクを包括的に管理するためにそうすることが賢明であると考えます。

EU AI法における品質管理システムとは何か?

遵守への道を進む上で最初にできることの一つは、AI品質管理システム(「QMS」)を構築することです。QMSの目的は、AIがもたらすリスクを管理する準備を整えることにあります。全体的であり、AIと組織がどのように関わるかを定める方針、手順、指示の形を取るべきです。

QMSには、以下を含める必要があります:

規制遵守の戦略(そして、AIシステムや規制の変更に対応する計画と手順を含むことが重要です);

リスク管理システムに関する要件(以下参照);

詳細な技術文書(再度、下記参照);

設計、設計管理、設計検証の技術;

品質管理および品質保証の手順;

データ管理に関するシステムと手続き;および

AIシステムがその生涯を通じてAIAに準拠し続けることを保証するための市場後モニタリングシステムの確立、実施、および保守。

初歩的な措置として、上記のポイントをカバーするAIポリシーを確立することをお勧めします。我々は、これらのAIポリシーの策定方法に関する無料で包括的なガイドを準備しましたので、こちらからアクセスできます。

EU AI法におけるリスク管理システムとは何か?

QMSの義務には、AIに関するリスク管理システム(「RMS」)を採用することが必要です。

ここでのQMSとRMSの違いは微妙ですが重要です。QMSは組織全体でどのようにリスクを管理し、規制に従うかをカバーしており、RMSは個々のAIシステムに関してどのようにリスクを管理し、規制に従うかをカバーしています。

RMSは、高リスクAIシステムのライフサイクル全体を通じて継続的、反復的なプロセスであり、体系的なレビューと更新が必要とされます。これには以下のステップが含まれます:

意図された目的に従って使用された時にAIシステムが健康、安全または基本的権利に及ぼし得るリスクの合理的に予測可能な識別と分析;

合理的に予測可能な誤用の条件下でAIシステムが使用された際に生じる可能性のあるリスクの評価と見積もり;

市場後モニタリングシステムから収集されたデータに基づくリスクの評価;および

上記の要件に従って特定されたすべてのリスクに対処するための適切で対象を定めたリスク管理措置の採用。

最終的に、RMSを通じて特定されたリスクは、各危険に関連する残存リスクおよび高リスクAIシステム全体の残存リスクが受け入れ可能であると判断されるべきです。リスクを排除できない場合には、適切な緩和および管理措置を採用する必要があります。また、試験に関する追加の要件と18歳未満の人への影響に関する追加の考慮があります。

新しい文書義務は何か?

QMSの要件は、組織が高リスクAIシステムが市場投入される前に技術文書を作成する必要があることも指定しています。法律の付属書IVは文書に関する特定の事項を示しています。最終的には、文書は、AIシステムがAIAの要件を満たしているか、権限を持つ当局や通知された機関に明確で包括的な見解を与えるのに十分でなければなりません。これには、QMSおよびRMSに関するすべての文書、およびシステムに関連する技術文書が含まれます。

これらの文書要件の一部は、我々のAIガバナンスソリューションを使用して自動化できます。我々の制御機能がそれをどのように自動化できるかをここで読んで、お問い合わせ下さい詳細をお確かめください。

基準の役割

基準はAIA遵守において中心的な役割を果たす予定であり、Enzaiでは、特定のフレームワークに市場が収束し始めているのを既に目にしています。米国標準技術研究所(NIST)はAIリスク管理フレームワークを発表し、我々はこれらの要件に準拠したフレームワークを開発するために多くの組織と協力してきました。2023年後半には国際標準化機構(ISO)および国際電子技術委員会(IEC)が42001基準を発表し、我々もこれを実装するために組織と協力しています。これらの基準はまだEUによって採用されていないため、それだけでは遵守を保証できません。AIAは、AIAの要件が完全には適用されない場合、またはAIAに記された関連する要件のすべてをカバーしていない場合には、組織はそのQMSがすべての技術的な法律仕様を組み込んでいることを保証する必要があると定めています。

一部の基準がEUによって承認される仕組みが設けられ、組織がこれらの基準を満たしていることを示せば、AIAへの適合性が推定されます。欧州電気技術標準化委員会CEN-CENELECは、統一基準を準備するために合同技術委員会21「人工知能」を設立しました。2024年1月現在、これらの基準の指定されたリリース日は発表されていませんが(またEUによる承認も確定されていません)、これらの基準がAIA遵守における重要な役割を果たすため、年の後半に出版日が発表されることを期待しています。

適合性評価とは何か?

適合性評価とは、その名の通り、AIシステムがAIAに適合しているかどうかを判断するための評価です。適合性の評価手続きは、いくつかの変数に依存します。例えば、前述の通り、AIシステムが統一基準に従っていることを示すことができる場合、適合性の仮定があります。特定の種類のシステムについては、社内の管理によって適合性評価が行われることもあり、他のシステムについては外部の通知機関によるレビューを伴うことがあります。

また、認証プロセスも確立され、承認されたシステムは製品にCEマークを付けることが認められます。さらに、大半の高リスクAIシステムは、サービス提供前にEUの中央データベースに登録される必要があります。

これらの運用メカニズムの一部の設置にはEUが多少の時間を要します。しかし、今すぐにQMSの確立をすることによって、準備が整うでしょう。

…心配はいりません、お手伝いします

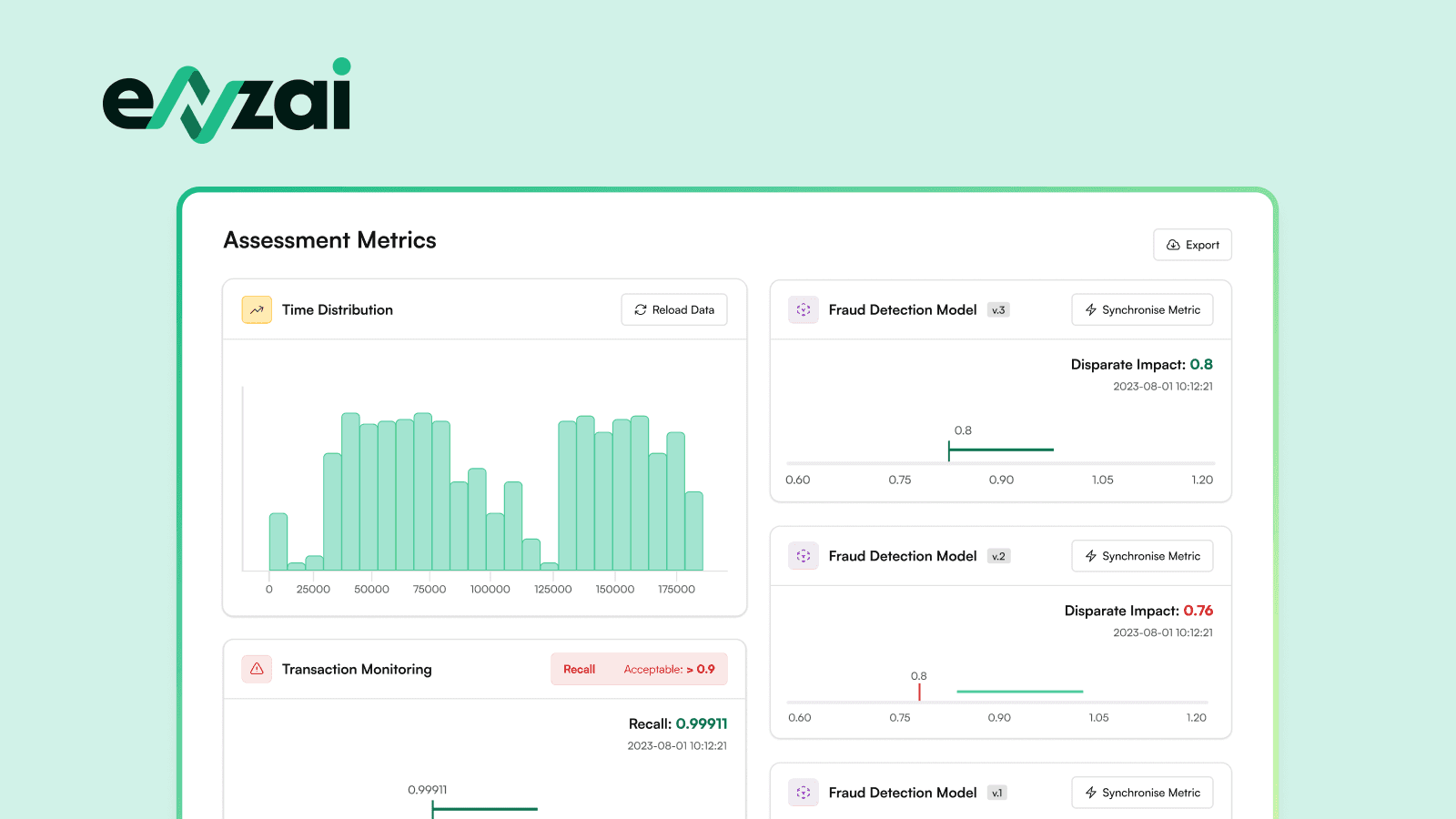

これらの新しい要件はやや圧倒的に思えるかもしれませんが、私たちはここにいてお手伝いします。我々のAIガバナンスおよびリスク管理ソリューションは、これらの義務にすべて即座に準拠するように設計されています。我々のソフトウェアプラットフォームはAIAが求める品質管理システムであり、我々の機能セットはすべてのAIシステムに関して迅速かつ効率的にリスク管理システムを展開できるように保証します。基準が完全に準拠しない場合でも、EnzaiのQMSは簡単に採用でき、すべてをカバーできるように設計されています。

お手伝い可能な方法について詳しく知るには、こちらよりお問い合せください。

組織がAIを採用し、管理し、監視する能力を、企業レベルの信頼性で強化します。規模で運営する規制対象の組織向けに構築されています。