Un aperçu de la signification et des éléments de la loi sur l'IA du Colorado

•

•

6 minutes de lecture

Sujets

Le 17 mai 2024, le gouverneur du Colorado, Jared Polis, a promulgué la Colorado Artificial Intelligence Act (« CAIA »). La CAIA constitue une étape importante pour la réglementation de l’IA aux États-Unis, car il s’agit de la première loi d’État à couvrir un large éventail de systèmes d’IA. Bien qu’un projet de loi similaire proposé dans le Connecticut ne soit pas devenu loi, il est probable que d’autres États suivront l’exemple du Colorado en réglementant largement l’utilisation de l’IA.

Comment la CAIA se compare-t-elle à l’EU AI Act ?

La CAIA présente des similitudes avec l’EU AI Act à trois égards.

Premièrement, la majorité des exigences des deux lois concernent les systèmes d’IA à haut risque. Deuxièmement, la conformité aux deux lois peut être démontrée, dans une large mesure, par l’alignement sur des normes telles que l’ISO/IEC 42001 - AI Management Systems. Troisièmement, les deux lois exigent des évaluations d’impact pour les systèmes à haut risque.

Il existe également au moins deux différences majeures entre la CAIA et l’EU AI Act.

Premièrement, les exigences de l’EU AI Act sont plus approfondies que celles de la CAIA. La CAIA, principalement axée sur la discrimination algorithmique, exclut plusieurs types courants de systèmes d’IA de sa définition de système d’IA à haut risque. Elle exempte également de nombreuses exigences les déployeurs de moins de 50 employés, s’ils remplissent certains critères.

Deuxièmement, la plupart de ses dispositions entreront en vigueur bien plus tôt que l’essentiel des dispositions de l’EU AI Act. Les entreprises disposent d’un peu moins de 20 mois pour se conformer à la CAIA, qui entrera en vigueur le 1er février 2026. À titre de comparaison, les exigences de l’EU AI Act relatives aux systèmes à haut risque n’entreront en vigueur qu’à la mi-2026, soit 24 mois après sa publication au Journal officiel de l’UE.

Quels systèmes d’IA sont couverts par la CAIA ?

La CAIA s’applique aux développeurs ou aux déployeurs de systèmes d’IA exerçant une activité dans le Colorado. Un développeur est une personne qui développe ou modifie intentionnellement et de manière substantielle un système d’IA, tandis qu’un déployeur est une personne qui déploie un système d’IA à haut risque.

Selon la CAIA, un système d’IA est à haut risque si, lorsqu’il est déployé, il « prend, ou constitue un facteur substantiel dans la prise d’une décision conséquente ». Une décision conséquente est une décision qui a « un effet juridique ou un effet significatif similaire sur l’octroi ou le refus à un consommateur, ou sur le coût ou les conditions » d’une inscription ou d’une opportunité éducative, d’un emploi ou d’une opportunité d’emploi, d’un service financier ou de prêt, d’un service public essentiel, de services de santé, d’un logement, d’une assurance ou d’un service juridique. En outre, certains types de systèmes d’IA sont exclus de la catégorie des systèmes à haut risque.

Comment la CAIA sera-t-elle appliquée ?

Le procureur général du Colorado aura l’autorité exclusive d’en assurer l’application et d’émettre les règles et orientations s’y rapportant. La CAIA ne prévoit pas de droit d’action privé. Si le procureur général du Colorado engage une procédure d’exécution, un déployeur bénéficiera d’une « présomption réfutable » selon laquelle il a fait preuve d’une diligence raisonnable pour protéger les consommateurs contre la discrimination algorithmique s’il dispose d’une politique et d’un programme de gestion des risques conformes au NIST AI Risk Management Framework (« AI RMF ») ou à l’ISO/IEC 42001. En outre, dans le cadre d’une procédure d’exécution, une entreprise dispose d’une « défense affirmative » si elle découvre et corrige une violation de la CAIA à la suite de retours d’expérience, de tests adversariaux ou de red teaming (tels que ces termes sont définis par le NIST), ou d’un processus d’examen interne, et qu’elle est par ailleurs « en conformité avec » le NIST AI RMF et l’ISO/IEC 42001.

Pour plus d’informations sur la manière d’élaborer une politique et un programme de gestion des risques, demandez notre guide gratuit et complet sur la façon de rédiger une politique d’IA ici.

Qu’exige la CAIA des développeurs et des déployeurs de systèmes d’IA à haut risque ?

La CAIA exige des développeurs et des déployeurs qu’ils fassent preuve d’une « diligence raisonnable » afin de protéger les personnes contre les risques connus ou prévisibles de discrimination algorithmique et qu’ils décrivent leurs utilisations d’IA à haut risque sur leurs sites web.

Les développeurs doivent informer le procureur général du Colorado et les déployeurs connus de tout risque connu ou raisonnablement prévisible de discrimination algorithmique sans délai déraisonnable et dans un délai de 90 jours. Les déployeurs doivent informer le procureur général du Colorado dès qu’ils apprennent qu’un système a causé une discrimination algorithmique, sans délai déraisonnable et dans un délai de 90 jours.

Les développeurs doivent fournir « une déclaration générale décrivant les utilisations raisonnablement prévisibles et les utilisations nuisibles ou inappropriées connues du système » accompagnée de la documentation connexe.

Les déployeurs doivent procéder à des évaluations d’impact des systèmes d’IA à haut risque chaque année et dans les 90 jours suivant toute « modification intentionnelle et substantielle » du système d’IA.

Les déployeurs doivent mettre en place une politique et un programme de gestion des risques, informer les personnes concernées avant qu’un système d’IA ne soit utilisé pour prendre une décision conséquente, expliquer aux personnes concernées comment les décisions conséquentes défavorables ont été prises, offrir la possibilité de corriger les informations personnelles inexactes liées à ces décisions et prévoir des voies de recours pour contester ces décisions.

Tous les systèmes d’IA doivent être « étiquetés »

Bien que la plupart des exigences de la CAIA concernent les systèmes d’IA à haut risque, son exigence d’étiquetage s’applique à tous les systèmes d’IA destinés à interagir avec des personnes. Pour de tels systèmes, un développeur ou un déployeur doit informer la personne qu’elle interagit avec un système d’IA, sauf si cela serait « évident pour une personne raisonnable ».

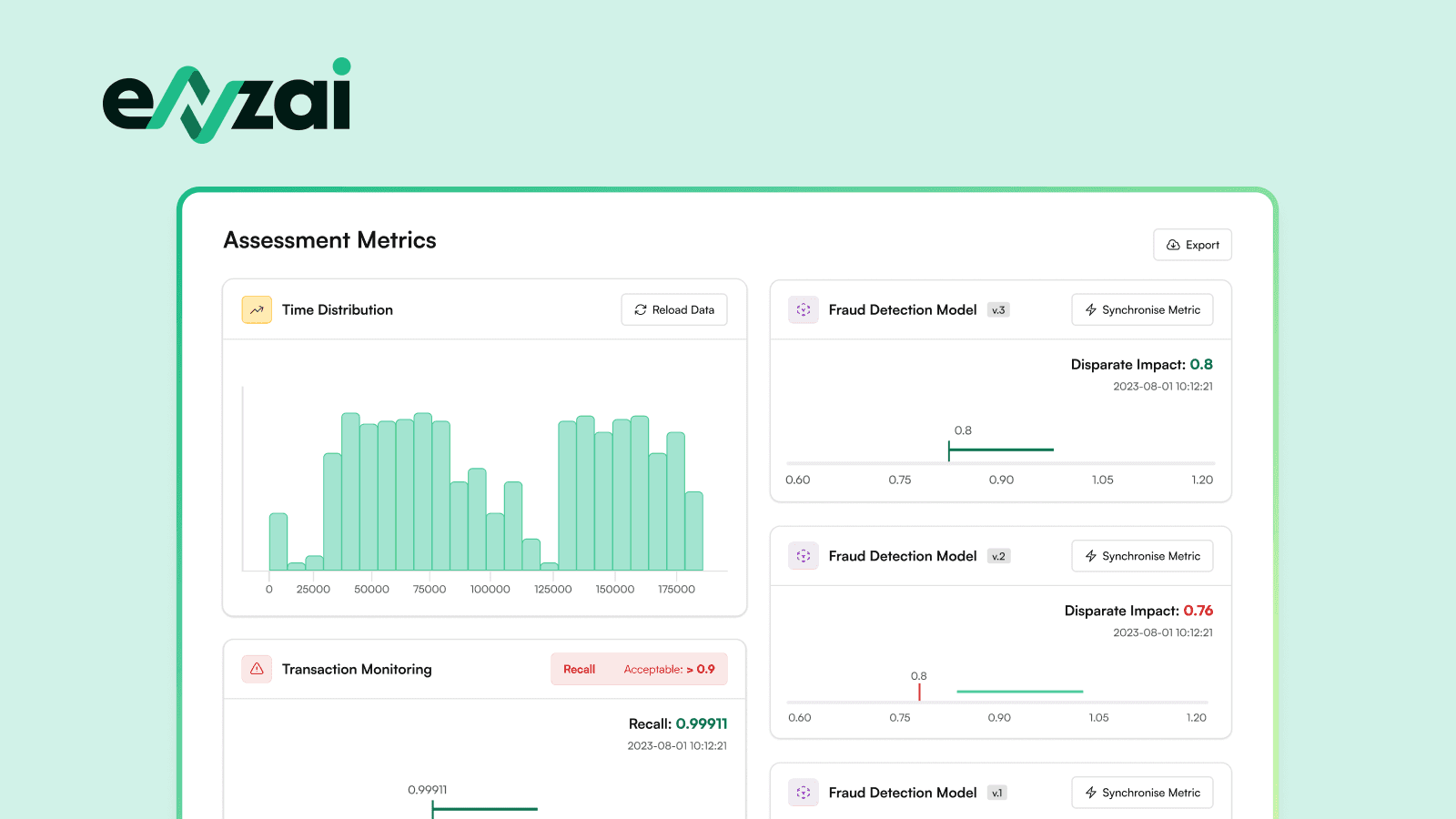

Enzai est là pour vous aider

Le produit d’Enzai peut aider votre entreprise à se conformer aux exigences du Colorado, au NIST AI RMF, à l’ISO/IEC 42001, à l’EU AI Act ainsi qu’à d’autres cadres réglementaires et d’assurance internationaux. Pour en savoir plus, contactez-nous ici.

Enzai est la principale plateforme de gouvernance de l’IA d’entreprise, conçue spécifiquement pour aider les organisations à passer d’une politique abstraite à une supervision opérationnelle. Notre plateforme de gestion des risques liés à l’IA fournit l’infrastructure spécialisée nécessaire pour gérer la gouvernance de l’IA agentique, tenir un inventaire de l’IA exhaustif et garantir la conformité à l’EU AI Act. En automatisant des flux de travail complexes, Enzai permet aux entreprises de déployer l’IA à grande échelle en toute confiance, tout en maintenant leur alignement avec des normes internationales telles que l’ISO 42001 et NIST.

Donnez à votre organisation les moyens d'adopter, de gérer et de surveiller l'IA avec une confiance de niveau entreprise. Conçu pour les organisations réglementées opérant à grande échelle.