Jüngste Maßnahmen und Richtlinien der FTC haben erhebliche Auswirkungen auf Organisationen

•

•

3 Minuten Lesezeit

Themen

Die Regulierung von KI in den USA ist ein Flickenteppich. Zunächst gelten für KI-Systeme die bestehenden Gesetze auf allen Ebenen. Was allgemeine Regeln für KI betrifft, so ist NISTs maßgeblicher AI Risk Management Framework freiwillig, die Trustworthy AI Executive Order der Biden-Administration sowie die nachfolgende OMB-Leitlinie gelten nur für die Bundesregierung, und Colorado ist derzeit der einzige Staat, der KI-Systeme umfassend reguliert. Andere Jurisdiktionen – wie New York City und Illinois – haben spezifische KI-Anwendungsfälle reguliert, etwa automatisiertes Recruiting.

Derzeit vermitteln die Leitlinien und Maßnahmen der U.S. Federal Trade Commission („FTC“) das klarste Bild davon, wie die Bundesregierung von Unternehmen erwartet, KI-Systeme einzusetzen. Jüngste FTC-Leitlinien haben versucht, aktuelle Entwicklungen zügig aufzugreifen. Im Februar verabschiedete die FTC eine Regel, die den Einsatz von KI-Deepfakes zur Imitation von Organisationen oder Regierungsbehörden verbietet. Im selben Monat warnte sie KI-Unternehmen davor, ihre Nutzungsbedingungen heimlich mit rückwirkender Wirkung zu ändern. Diese Aktivitäten kommen zusätzlich zur Prüfung von Investitionen und Übernahmen durch große Technologieunternehmen aus kartellrechtlicher Perspektive hinzu. Im Mai verfasste FTC-Vorsitzende Lina Khan einen Meinungsbeitrag in der New York Times, in dem sie ihren vorgeschlagenen Ansatz zur KI-Regulierung darlegte.

Warum war der Fall Rite Aid im Dezember so wichtig?

Im Dezember 2023 gab die FTC eine Einigung mit der Apothekenkette Rite Aid bekannt. Rite Aid hatte „Gesichtserkennungstechnologie an Hunderten seiner Einzelhandels-Apothekenstandorte eingesetzt, um Kunden zu identifizieren, die man zuvor als wahrscheinlich eingestuft hatte, Ladendiebstahl oder anderes kriminelles Verhalten zu begehen“, so eine FTC-Beschwerde. In der Einigung verpflichtete sich Rite Aid, fünf Jahre lang in seinen Filialen oder online keine Gesichtserkennungssysteme einzusetzen und Fotos und Videos von Kunden zu löschen, die unrechtmäßig in Gesichtserkennungssystemen verwendet wurden, einschließlich der daraus abgeleiteten „Daten, Modelle und Algorithmen“.

Welche Auswirkungen hat dies für Organisationen, die KI einsetzen?

Die Einigung der FTC mit Rite Aid war aus zwei Gründen bemerkenswert. Erstens verdeutlichte sie die Auslegung von KI-Diskriminierung durch die FTC. Zweitens markierte sie den fortgesetzten Einsatz von Model Disgorgement als Abhilfemaßnahme.

KI-Diskriminierung

In Bezug auf KI-Diskriminierung stellte die FTC fest, dass der Einsatz von Gesichtserkennungssystemen durch Rite Aid die hohen False-Positive-Raten über demografische Gruppen hinweg nicht berücksichtigte. Außerdem deutete sie an, dass die Auswahl der Filialen für den Einsatz von Gesichtserkennung voraussichtlich eine unverhältnismäßig diskriminierende Wirkung auf Minderheitengruppen gehabt hätte.

Model Disgorgement

Die FTC verlangte zudem Model Disgorgement, ein relativ neues Rechtsmittel, das sie 2019 erstmals entwickelt hat und das eine Organisation verpflichtet, Daten, Modelle und Algorithmen zu löschen, die aus unsachgemäß eingesetzten KI-Systemen abgeleitet wurden. Seit 2019 hat die FTC Model Disgorgement bereits in zahlreichen Fällen verlangt, darunter im Zusammenhang mit Cambridge Analytica, Everalbum, WW (ehemals Weight Watchers) und Ring. Es ist wahrscheinlich, dass die FTC in künftigen KI-Durchsetzungsmaßnahmen ebenfalls Model Disgorgement verlangen wird.

Lehren

Zu den Lehren, die Organisationen aus dem Fall Rite Aid ziehen sollten, gehören:

· Führen Sie KI-Risikobewertungen durch

· Richten Sie umfassende Schulungsprogramme für Mitarbeitende ein, die hochriskante KI-Systeme betreuen

· Berücksichtigen Sie den Einsatzkontext von KI, einschließlich möglicher diskriminierender Auswirkungen

· Prüfen Sie Datensätze sorgfältig auf Genauigkeit, Verzerrungen und Eignung für den vorgesehenen Zweck

· Seien Sie gegenüber den Betroffenen transparent, wie ihre Daten verwendet werden

· Wägen Sie sorgfältig ab, wie und in welchem Umfang KI-Systeme gegenüber der Öffentlichkeit und Aufsichtsbehörden beschrieben werden

· Bewerten Sie die Datenschutz- und Responsible-AI-Praktiken Ihrer Anbieter

Enzai unterstützt Sie dabei

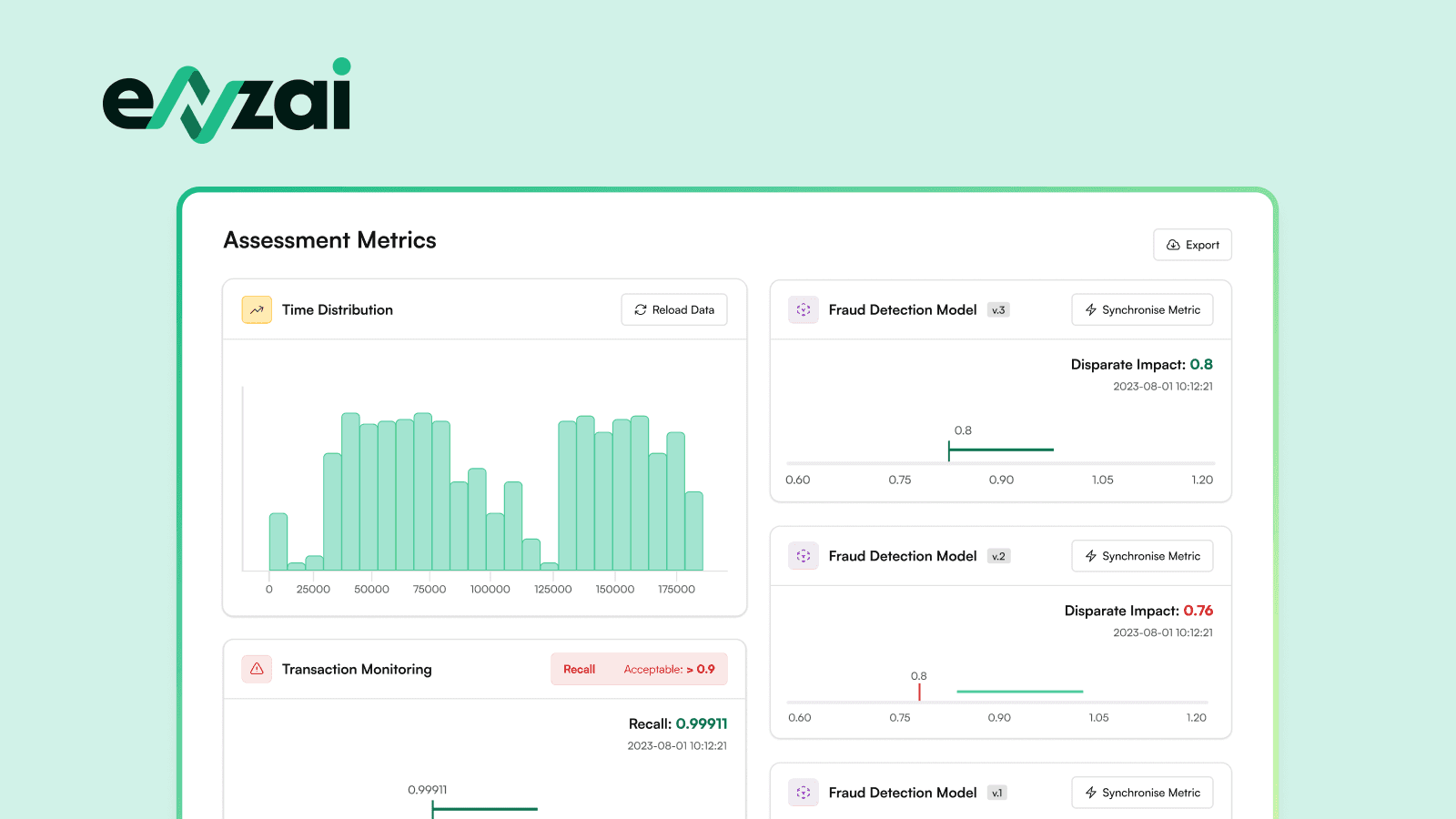

Das Produkt von Enzai kann Ihrem Unternehmen dabei helfen, KI in Übereinstimmung mit bewährten Verfahren sowie neuen Vorschriften, Standards und Frameworks wie dem EU AI Act, dem Colorado AI Act, dem NIST AI RMF und ISO/IEC 42001 einzusetzen. Wenn Sie mehr erfahren möchten, nehmen Sie hier Kontakt auf.

Enzai ist die führende Enterprise-KI-Governance-Plattform, die speziell dafür entwickelt wurde, Organisationen den Übergang von abstrakten Richtlinien zu operativer Aufsicht zu ermöglichen. Unsere Plattform für KI-Risikomanagement bietet die spezialisierte Infrastruktur, die erforderlich ist, um Governance für agentische KI zu steuern, ein umfassendes KI-Inventar zu führen und die Einhaltung des EU AI Act sicherzustellen. Durch die Automatisierung komplexer Arbeitsabläufe ermöglicht Enzai Unternehmen, die Einführung von KI mit Zuversicht zu skalieren und dabei im Einklang mit globalen Standards wie ISO 42001 und NIST zu bleiben.

Ermöglichen Sie Ihrer Organisation die Einführung, Steuerung und Überwachung von KI mit unternehmensgerechtem Vertrauen. Entwickelt für regulierte Organisationen, die im großen Maßstab operieren.